La habitación china o la consciencia de las máquinas

El experimento de Searle de 1980 sigue sin respuesta: si el sistema completo produce resultados coherentes, ¿importa que ninguna pieza entienda lo que hace?

Creado: 2024-03-31 09:41

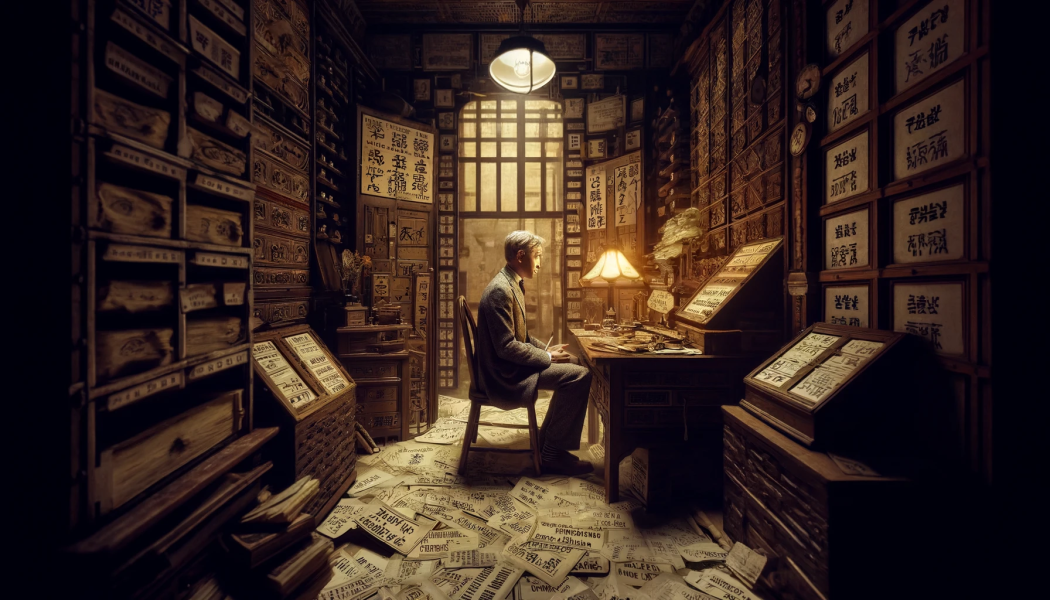

Imagina que viajamos a 1924 y presentamos a políticos y científicos de la época una habitación dentro de la cual tenemos una máquina que es capaz de entender el idioma chino. Allí se acaba de crear el Partido Comunista y a los políticos occidentales eso no les huele nada bien.

La habitación tiene una ranura por la que introducimos un texto en chino, en lenguaje natural, y nos da una respuesta perfectamente ajustada y coherente. Todavía tendríamos que esperar 26 años para que Turing inventase su test pero, definitivamente, nuestra máquina lo pasaría sin problemas. Cualquier hablante de chino confirmaría que sí, que la máquina entiende el idioma a la perfección. No traduce, no, entiende lo que le pedimos y es capaz de sacar conclusiones del texto.

Si mirásemos dentro de la máquina tendríamos a un jovencísimo filósofo americano llamado John Rogers Searle (que no nacería hasta 8 años después, pero permitidme la licencia), que sabe mucho de filosofía y lenguaje pero no tiene la menor idea de chino. Lo que sí que tiene es una cantidad ingente de libros con caracteres en mandarín y un gran manual que le indica cómo manipular los símbolos, de manera que sepa qué caracteres tiene que responder para una serie de símbolos de entrada determinados: Si recibes 你有思考的能力 respondes sin dudarlo 当然,就像你一样.

Searle lleva meses entrenando y lo hace a una velocidad pasmosa. Rebusca entre papeles hasta que encuentra la cadena de entrada correcta y dibuja en el papel de salida los simbolillos sin significado para él, pero que maravillan al hablante de chino que los recibe y, por ende, a los políticos que nos ofrecen millones de dólares de la época.

Volvamos a nuestros días, cien años después, y traduzcamos todo esto a lenguaje que ya nos es muy común. La habitación llena de manuales sería la base de datos, el manual para tratarlos, el programa. El papel que le introducen por la ranura de entrada sería la pregunta y el de salida la respuesta. Para las personas fuera de la habitación, la máquina comprende el chino, pero la persona que manipula los papeles realmente no tiene ni idea, sólo sigue un programa y manipula dibujos sin entender absolutamente nada, ni la semántica ni el significado.

Searle escribió este experimento, al que llamó La habitación china, en un paper publicado en la revista Behavioral and Brain Sciences en 1980.

Este experimento intentaba dar solución a debate en el que estamos ahora, casi medio siglo después (sí, han pasado ya 44 años desde el 80. Ya, yo también alucino 🤯), sobre si los algoritmos de IA generativa piensan, comprenden, razonan, tienen un modelo del mundo o sólo siguen instrucciones sin entender ni papa.

Searle no sabe chino, pero ¿podemos decir que la habitación con él dentro, los libros y el manual sí?

Él decía en su artículo que la sintaxis sola nunca podría producir resultados semánticos , pero el nuevo paradigma creado con la representación vectorial de las palabras (embeddings) y la posibilidad de obtener resultados coherentes, y a veces sorprendentes, operando con esos vectores, ¿nos hace plantearnos lo contrario?.

Aquí te dejo el artículo original de Searle para que eches un rato y puedas contestar a la pregunta del maestro de la ciencia ficción Philip K. Dick ¿Sueñan los androides con ovejas eléctricas? ¿Tú qué crees?