Living in the future

Hiperconectividad y capacidad de proceso borran la frontera entre lo físico y lo digital: los avances que hemos vivido ya no se desinventan.

Creado: 2021-10-19 10:06

“Vivimos en el futuro”, “esto es Matrix”. Leemos y escuchamos afirmaciones similares todos los días. Es cierto que todo va muy rápido y que los cambios de la mano de la tecnología están siendo espectaculares, pero ¿dónde estamos? y sobre todo ¿hacia dónde vamos? Este artículo no intenta dar respuestas a nada, pero sí hacerte pensar desde un punto de vista abierto sobre el mundo en el que vivimos.

Desde mi punto de vista todos los avances de las últimas décadas nos están acercando a la convergencia entre el mundo físico , el único que conocieron nuestros bisabuelos, y el virtual. Y fijaos bien que no digo “el mundo real” porque lo que estamos viviendo es que tanto mundo físico como mundo virtual, son igual de reales.

Pero ¿cómo se está produciendo esto? ¿qué cambios son los que han propiciado esta aceleración? Básicamente son dos ya conocidos desde hace tiempo: hiperconectividad , que podemos resumir en la capacidad de tener personas y objetos conectados entre sí a través de una red, Internet en casi todos los casos, y capacidad de proceso que, hasta que no se demuestre lo contrario, sigue duplicándose cada dos años siguiendo fielmente la Ley de Moore desde hace más de 55 años. Ojo ahora a la Ley de Huang, que promete ser el nuevo paradigma.

Al final, los seres humanos somos el centro de nuestro universo, claro, y replicar un mundo físico hecho, o moldeado, a la medida del ser humano requiere que la interacción con este espacio digital sea similar a la que tenemos con nuestro entorno físico.

Sensorización y modelado para poder digitalizar el mundo físico

Lo primero que necesitamos para replicar el mundo real en un entorno digital es saber cómo es éste y eso se consigue sólo de una manera: midiendo. Datos, datos, la realidad es una acumulación de datos. Si somos capaces de medir todos los parámetros que definen un objeto estamos más cerca de poder replicarlo y, sobre todo, de poder entenderlo.

Una de las técnicas que más han ayudado a la humanidad a entender cómo funciona nuestro entorno es la creación de modelos: fórmulas más o menos complejas que partiendo de unos datos de entrada son capaces de saber cuál será la salida. A veces son certeras, como que el área de una superficie circular de 2 metros de diámetro es de 12,566 metros cuadrados, y otras aproximadas con más o menos tolerancia, como si mañana lloverá o no en tu barrio.

Para predecir el futuro necesitamos “sólo” esas dos cosas, los datos de entrada y la fórmula que nos dará la salida. El problema que tenemos en el caso de las predicciones meteorológicas es que para predecir algo binario como “llueve mañana a las 4” necesitamos MUCHAS fórmulas y MUCHOS datos de entrada. Ya trabajamos con gran parte de esas fórmulas; la mecánica de fluidos es una ciencia exacta y conocemos gran parte de las relaciones entre la temperatura del aire y su movimiento, si sabemos además la humedad podemos calcular la evaporación… dale a un meteorólogo TODOS los datos que te pida y te hará una previsión infalible, pero claro, conocemos esos datos de puntos concretos en momentos concretos, no de cada centímetro cúbico de aire y agua del planeta, así que siempre será una aproximación.

Nuestro cuerpo funciona de la misma manera, nos tomamos la temperatura y podemos sacar conclusiones sobre lo que está pasando dentro, nos pinchamos en un dedo y podemos saber la cantidad de glucosa que tenemos en la sangre. Pero eso no son más que fotografías estáticas de parámetros que evolucionan constantemente en función de multitud de otras cosas: qué hemos comido y cuándo, si estamos en movimiento o tumbados en la cama… Cada vez más hay dispositivos que acercan esa fotografía a un vídeo, como las pulseras o smartwatches que miden nuestro pulso y temperatura de una forma continua o un parche medidor de glucosa que almacena en tiempo real tu nivel de azúcar en sangre. Lo que estos datos nos permiten hacer y, sobre todo, nos permitirán hacer en el futuro, es casi inimaginable.

Procesamiento de los datos, la inteligencia de la máquina:

Una vez que tenemos los datos hay que procesarlos, meterlos dentro de esos modelos de los que hemos hablado y extraer las conclusiones. Pero MUCHOS datos requieren MUCHA capacidad de cálculo. Los ordenadores han avanzado a toda velocidad y lo siguen haciendo, pero, hasta ahora, hacía falta que una persona entendiese el problema y escribiese el código necesario en ellos para crear ese modelo. Una de las palabras de moda desde hace tiempo, la Inteligencia Artificial, ha venido para cambiar todo eso.

La Inteligencia Artificial, así, en una definición de andar por casa, es poco más que estadística a lo bruto. Como ya demostraron Los Pelayo, si tienes datos puedes saber dónde va a caer la bola en la ruleta. Imagina que tienes una caja negra que quieres entrenar para saber si una foto es de un caballo o de una cebra. La caja se ordena internamente con cada foto que le das. Al principio se equivoca mucho, un 50% de las veces según las leyes de la probabilidad, pero con el tiempo, mejor dicho con los datos, va afinando sus predicciones hasta que ya no falla una.

Obviamente esto no es tan sencillo, pero los avances de los últimos años en algoritmos de Machine Learning han hecho posibles modelos como Alphafold 2, un programa al que le das una secuencia de proteínas y es capaz de dibujarte con asombrosa precisión cómo se colocan en el espacio. No sé de IA ni de biología lo suficiente para explicarte lo que hace, cómo lo hace y qué repercusiones tiene, pero los biólogos moleculares están dando palmas porque un trabajo que antes llevaba meses o años se ha reducido a… diez minutos de proceso. La cantidad de medicamentos, tratamientos y conocimiento de cómo funcionan las estructuras vivas que este software va a acelerar es increíble.

Podríamos seguir enumerando logros de la Inteligencia Artificial. En los últimos años han sido muchos y raro es el día que no se publica un paper con alguna novedad revolucionaria.

Outputs

Pero, ¿cómo consumimos las personas esos datos?. Nuestros periféricos no son muchos, cinco sentidos con algunas limitaciones, y engañar al cerebro para que crea que pasan cosas que realmente no pasan no es tan complicado.

Ponte auriculares, cierra los ojos y escucha este audio y verás qué sencillo es hackear uno de esos sentidos. El olfato y el gusto van bastante por detrás en la carrera de meternos en ese mundo virtual. El tacto ya tiene productos comerciales, sí, muy aparatosos y principalmente para videojuegos, pero ya sabemos que el porno y los videojuegos son las pistas de pruebas del resto de las industrias.

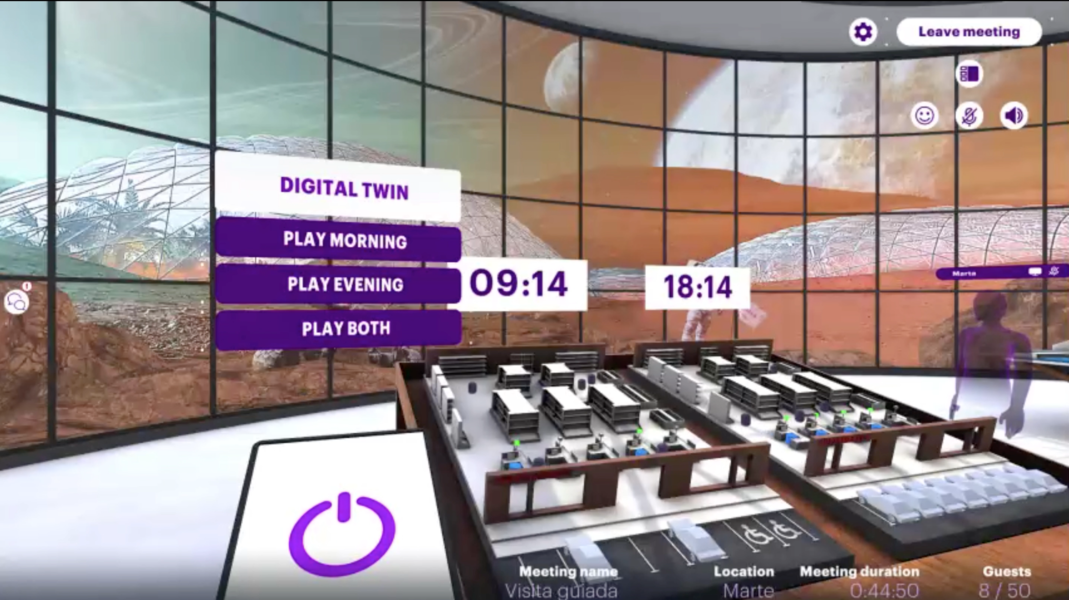

Y nos queda la vista. Ahí es donde está habiendo avances a todo tren. Veremos avances reales en cuanto estén en el mercado las tan cacareadas gafas de realidad virtual de Apple, o cualquiera de sus competidores, y las mezclemos con el nuevo proyecto de Facebook, Ego4D, (Egocentric 4D Perception). intentan enseñar a una máquina qué y cómo vemos nuestro entorno entrenando a una IA con un dataset de 3.000 horas de vídeo grabadas desde la perspectiva de la persona que interactúa con el espacio.

La nueva realidad

Como ves, todo esto está convergiendo en una mezcla de mundo físico y digital en el que no se sabe dónde acaba uno y dónde termina el otro. Hoy ya vivimos en una realidad (real) a medida. Vemos retransmisiones de eventos deportivos en televisión en las que la publicidad de las vallas físicas cambia dependiendo del país del espectador. Lo siguiente es que tengamos contenidos y anuncios personalizados en películas y series basados en un perfil realizado por un algoritmo que nos conoce mejor que nuestra madre.

Son tiempos interesantes. Deepfakes, actores virtuales, doblajes automáticos en películas… cada vez más y más barreras entre la Realidad Física y la Sintética se funden. Computación cuántica, blockchain, transformers, GPT3, etc podemos hacer una lista de palabras y tecnicismos que se ponen de moda e intentar colocarlas en un timeline a futuro. Muchas desaparecerán, otras cambiarán tanto que no sabremos reconocerlas y muchas más están a punto de surgir cada día.

¿Dónde está el límite? y, sobre todo, ¿sabremos hacer convivir esta nueva revolución con la sostenibilidad del planeta? Esto último es responsabilidad nuestra, no de las máquinas.