Llevamos ya unos días con GPT-5 y yo, al menos, tengo claras ya algunas cosas:

El enrutador de GPT-5 decide entre fast, thinking o Pro según la complejidad. Thinking en API acierta casi siempre, pero tarda. 3.000 usos semanales por ahora.

Tras una semana de uso intensivo de GPT-5 Thinking en la API, hay algunas conclusiones que ya se pueden sacar con cierta confianza. El enrutador automático mejora con el uso, el modelo Pro acierta casi siempre aunque tarda, y los límites son más generosos de lo que parecía. Aquí van las notas de campo.

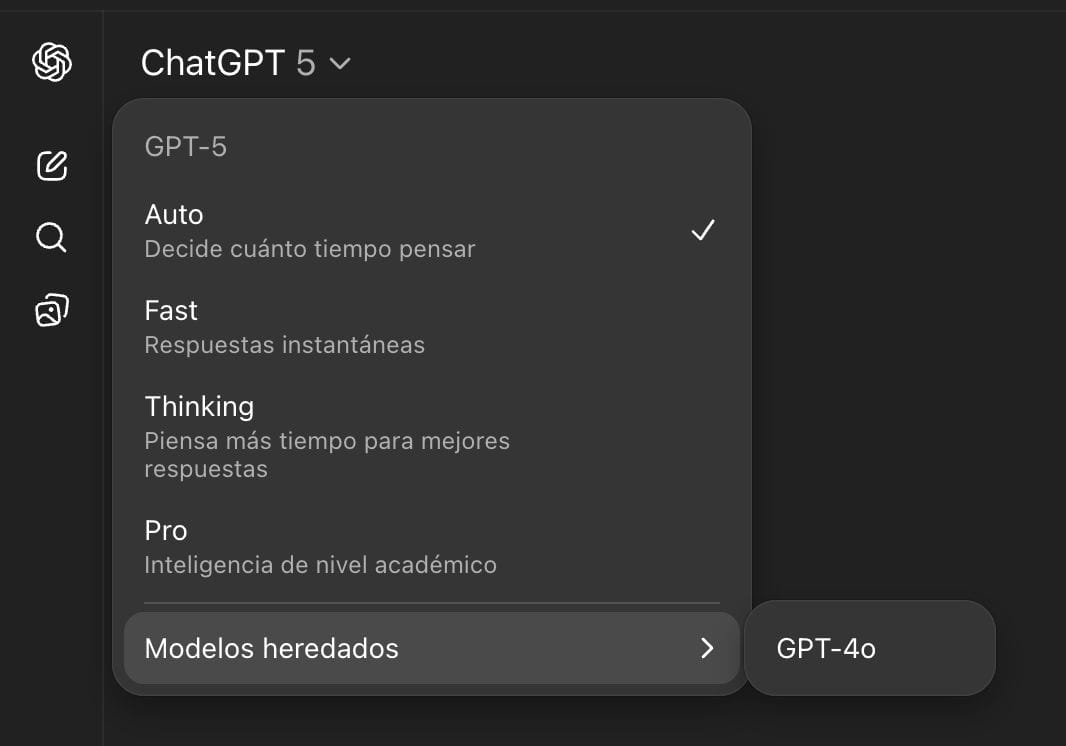

- El enrutador que, por defecto, te envía a modelos más o menos “listos” ha ido mejorando desde que lo sacaron. Lo que hace es decidir si usa “fast” o “thinking” (o “Pro” si pagas lo suficiente) dependiendo de la complejidad de la pregunta. Tened en cuenta que la mayor parte de los usuarios ni se han fijado en este desplegable, preguntan como si fuese Google y ya. El desplegable se entiende mejor, pero tampoco es que sea lo más claro del mundo.

- El modelo Thinking y, sobre todo, el Pro (para los usuarios Pro o Teams) son MUY buenos.

- He estado usando intensivamente GPT-5 Thinking (API) para programar y es muy bueno pero muy lento. Acierta casi siempre con lo que le digo pero, claro, porque lo piensa mucho.

- Los límites también han cambiado. Ahora son 3.000 usos de Thinking a la semana, más de 400 interacciones al día. Not bad.

- Han rescatado GPT-4o para los nostálgicos. Ha habido mucha gente diciendo que echaban de menos lo pelota que es ese modelo 😂