¿Estás construyendo sobre IA cosas que la propia IA hará innecesarias

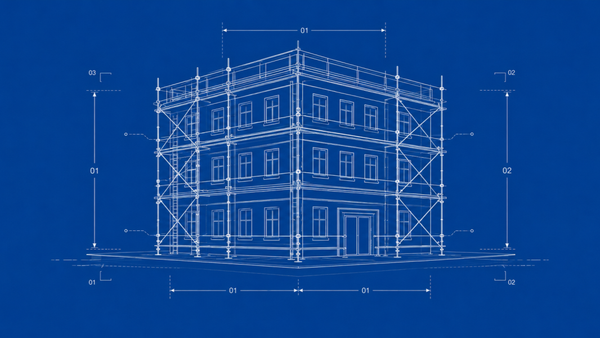

Scaffolding vs. contexto: cada mejora del modelo hace el andamio más obsoleto y el contexto más valioso. Lo que construyes, ¿vale más o menos con el siguiente modelo?

Hay dos formas de construir sobre modelos de lenguaje y solo una va a sobrevivir a la próxima versión del modelo. La diferencia entre scaffolding, compensar lo que el modelo no sabe hacer, y contexto, darle lo que no puede saber por sí solo, no es técnica. Es estratégica, y cada iteración del modelo hace que esa distinción importe más.

¿Estás construyendo sobre IA cosas que la propia IA hará innecesarias?

Hay dos formas de construir sobre modelos de lenguaje y sólo solo una va a sobrevivir.

La primera es compensar lo que el modelo no sabe hacer. Poner orquestadores que deciden qué prompt usar, routers que eligen entre modelosy pipelines que trocean documentos, los reordenan y los filtran antes de que el modelo los vea. En el argot se llama “scaffolding”.

La segunda es darle al modelo lo que no puede saber. Quién eres, cómo piensa tu equipo, qué se decidió y por qué. El contexto es lo que convierte una respuesta genérica en una respuesta útil.

La diferencia principal es que cada vez que el modelo mejora el scaffolding sobra un poco más y el contexto vale un poco más. Anthropic nos dice que Claude Code es “el wrapper más fino posible” pero luego te pide que escribas un CLAUDE.md con las reglas de tu proyecto. Parece una contradicción pero es la tesis. El modelo no necesita que lo guíes, necesita que lo informes.

La pregunta para cualquiera que esté invirtiendo en IA ahora es: lo que estás construyendo, ¿se vuelve más valioso o menos valioso cuando salga el siguiente modelo?

Si la respuesta es “menos”, estás construyendo algo que el próximo modelo hará gratis. Suerte!